Однако для родителей, чья юность прошла без умных колонок и генеративных чат-ботов, это цифровое пространство часто остается терра инкогнита. Мы даем ребенку планшет «чтобы не плакал» или разрешаем спросить у «Алисы» ответ на задачку, не задумываясь, какие глубинные процессы стоят за этим взаимодействием. Чтобы экранный друг не стал врагом, важно понимать три главные группы рисков и освоить базовые правила цифровой гигиены.

Теневая сторона диалога: какие риски несут нейросети

Когда школьник общается с ИИ, он вступает в диалог с системой, которая имитирует человеческое поведение, но лишена моральных ориентиров и эмпатии. Это создает специфические угрозы, о которых важно знать каждому родителю.

Первый и самый очевидный риск - это неадекватные и опасные ответы. В отличие от человека, нейросеть не «понимает» смысла сказанного, а лишь предсказывает следующее слово на основе огромных массивов данных. Это приводит к так называемым «галлюцинациям» - выдаче выдуманных фактов за реальные. Но еще страшнее, когда фильтры безопасности дают сбой.

Исследования популярных чат-ботов, включая Google Gemini, показали шокирующие результаты: даже в режимах, предназначенных для детей до 13 лет, нейросети могут выдавать инструкции по употреблению наркотиков (от марихуаны до ЛСД), детальные описания сексуального контента или вредные советы по ментальному здоровью . Это происходит не по злому умыслу, а из-за пробелов в настройках систем безопасности. Представьте, что ваш ребенок-восьмиклассник, стесняясь спросить у вас о «запретных» темах, идет за разъяснениями к «умному» алгоритму и получает не просто искаженную, а опасную картину мира.

Второй риск, который часто недооценивают, 0 это формирование эмоциональной зависимости и нарушение социализации. Дети, особенно склонные к одиночеству или испытывающие трудности в общении со сверстниками, легко проецируют человеческие качества на бездушную программу . Опросы показывают, что более трети детей, использующих чат-ботов, говорят, что общение с ИИ похоже на дружбу. А 26% уязвимых детей признались, что предпочли бы разговор с ботом, чем с реальным человеком .

Эксперты по кибербезопасности бьют тревогу: дети привыкают к ИИ с раннего возраста, не осознавая сложности технологий . Умная колонка не устает, не перебивает и всегда готова играть - это создает иллюзию идеального друга. Но плата за это - утрата навыка договариваться со сверстниками, проживать конфликты и считывать невербальные сигналы. Психологи называют это риском «цифровой деменции», когда сворачиваются социальные контакты и снижается эмоциональный интеллект.

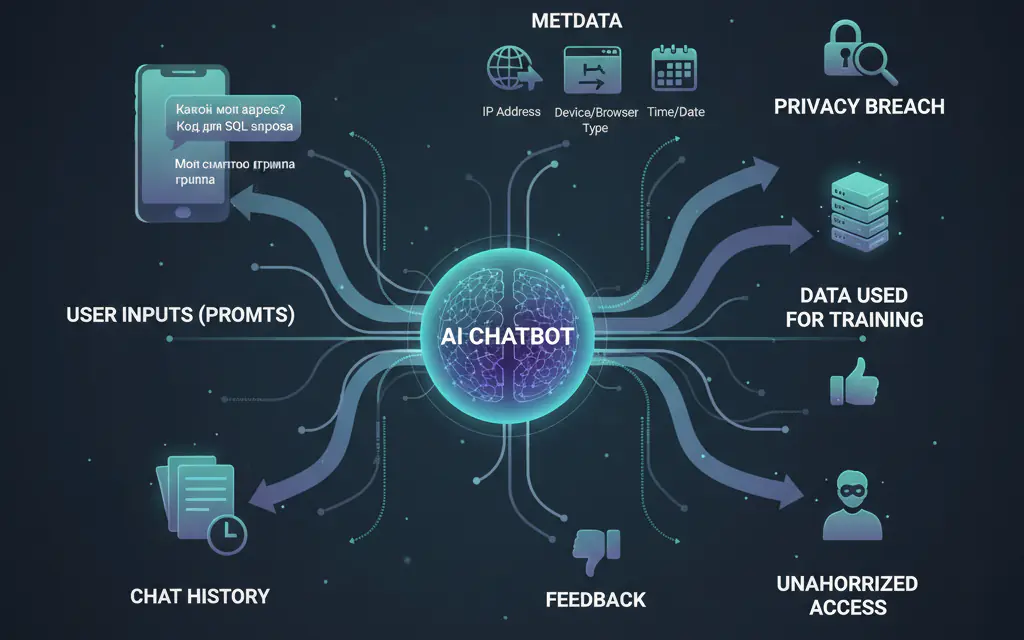

Третий риск лежит в плоскости конфиденциальности и сбора данных. Многие родители не задумываются, что, задавая вопрос нейросети, ребенок «скармливает» алгоритмам личную информацию. Чат-боты запоминают историю диалогов, имена, семейные обстоятельства, адреса и даже геолокацию. Искусственный интеллект обучается на этих данных, и в случае утечки или недобросовестности разработчика интимная информация может стать доступной третьим лицам. Особенно цинично это выглядит в контексте тактик удержания внимания: некоторые платформы намеренно используют манипулятивные приемы, чтобы заставить ребенка проводить внутри приложения как можно больше времени, поощряя платные функции или создавая навязчивую привязанность.

Стратегия спокойствия: как родителям взять ситуацию под контроль

Запретить ребенку пользоваться технологиями - путь заведомо проигрышный, ведь ИИ станет неотъемлемой частью его взрослой жизни. Наша задача - не оградить, а научить безопасному плаванию в этих водах. И начинается этот процесс не с установки программ, а с разговора.

Вместо того чтобы просто выключать компьютер, когда вы застали ребенка за сомнительным диалогом, попросите его показать, как он пользуется нейросетью. Спросите: «А как ты думаешь, откуда бот знает ответ?». Объясните, что ИИ - это не волшебник и не живое существо, а сложная программа, похожая на продвинутый калькулятор слов. Она не испытывает чувств и не несет ответственности за свои советы. Это закладывает фундамент здорового скептицизма. Исследования подтверждают: ключевым навыком для ребенка остается способность критически оценивать информацию, а не слепо доверять авторитету машины .

Следующий шаг - использование технических средств защиты, которые постепенно появляются у разработчиков. Сегодня уже существуют инструменты родительского контроля для нейросетей. Например, в ChatGPT появилась функция, позволяющая родителям привязать аккаунт ребенка к своему. Вы можете отключить голосовой режим или генерацию изображений, установить временные лимиты и, что самое важное, запретить чат-боту запоминать историю диалогов . Более того, OpenAI анонсировала систему оповещений: если ребенок начнет обсуждать с ботом темы суицида или самоповреждения, модераторы компании могут рассмотреть этот диалог и предупредить родителей . Аналогичные функции внедряются и другими крупными игроками.

Тем не менее, ни один фильтр не заменит живого контроля. Введите правило: ребенок использует голосовые помощники или чат-боты только в общих комнатах, а не в своей спальне за закрытой дверью. Это снижает риск ухода в опасные темы и нормализует процесс. Кроме того, полезно иногда проверять историю диалогов - не для тотальной слежки, а чтобы понимать круг интересов ребенка и вовремя подкорректировать его курс. Если вы видите, что школьник использует ИИ, чтобы полностью переложить на него решение домашних заданий, это повод для беседы о честности и развитии мышления. Психологи напоминают: когда ученик получает готовые ответы, не прилагая усилий, его навыки анализа и осмысления атрофируются .

Наконец, стоит обратить внимание на альтернативы. Если ребенок ищет общения, возможно, ему не хватает вашего внимания или контактов в реальной жизни. Вместо того чтобы позволять ему замыкаться в диалогах с «виртуальными друзьями», запишите его в кружок, где нужно взаимодействовать с другими детьми. Живое общение, объятия и совместные открытия в реальном мире - единственное, что действительно может насытить эмоциональный голод, который не способен утолить никакой, даже самый совершенный алгоритм.

Заключение

Нейросети прочно вошли в жизнь наших детей, и этот процесс необратим. Они могут стать мощным инструментом для обучения, развития творческих способностей и поиска информации. Но как огонь, который греет, но может и сжечь дом, ИИ требует уважения и контроля. Баланс достигается не запретами, а включенностью: разговаривайте с детьми о том, как устроен мир технологий, настраивайте программы безопасности вместе и будьте для них главным авторитетом, к которому можно прийти с любым вопросом, даже если ответ на него уже выдал бездушный, но дружелюбный голос из колонки.